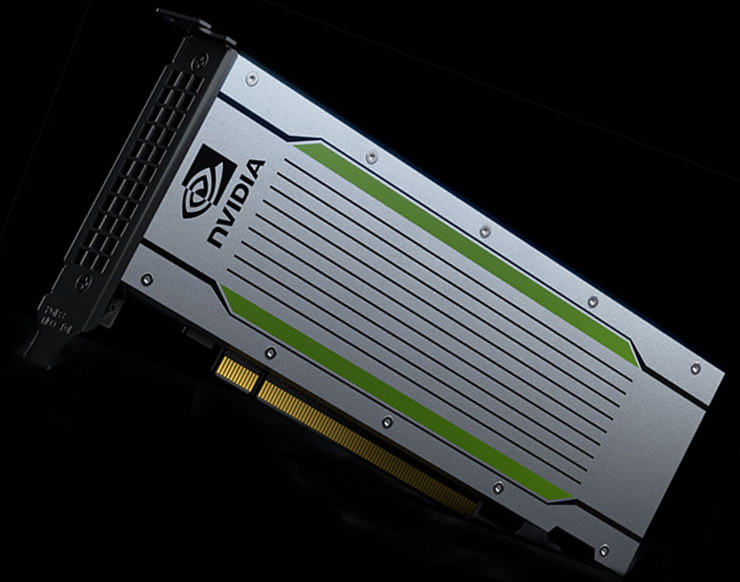

Tesla T4

TENSOR核心GPU

NVIDIA® Tesla® T4 GPU 是世界上极其先进的推理加速器。

扩展服务器进行优化,并且旨在实时提供极其先进的推理。

搭载 NVIDIA Turing™ Tensor Core 的 T4 提供革命性的多精度推理性能,

以加速现代人工智能的各种应用。

T4 封装在节能的小型 70 瓦 PCIe 中,可针对横向扩展服务器进行优化,

并且旨在实时提供极其先进的推理。

| Tesla T4参数 | |

|---|---|

| GPU架构:NVIDIA Turing | ECC:YES |

| CUDA核心数量:2560 | 互联带宽:32GB/s |

| 单精度:8.1TFLOPS | 系统接口:x16 PCIe Gen3 |

| 混合精度(FP16/FP32):65TFLOPS | 外形尺寸:PCIe 半高卡 |

| INT8:130TOPS | 散热解决方案:被动式 |

| INT4:260TOPS | 计算API:CUDA |

| GPU显存:16GB GDDR6 300GB/s | NVIDIA TensorRT™ |

| Tensor 核心数量:320 | ONNX |

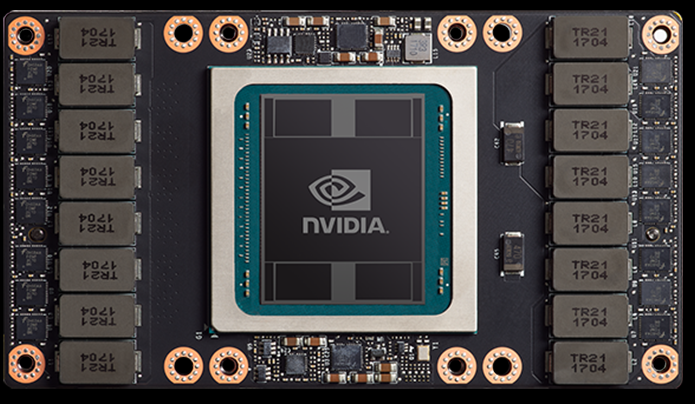

Tesla V100

NVLink接口的NVIDIA TESLA V100

为深度学习提供卓越性能

PCIe接口的NVIDIA TESLA V100

通用性出众适合处理各种工作负载

| Tesla V100参数 | ||

|---|---|---|

| NVLink版本 Tesla V100 | PCIe 版本Tesla V100 | |

| 双精度 | 7.8 TeraFLOPS | 7 TeraFLOPS |

| 单精度 | 15.7 TeraFLOPS | 14 TeraFLOPS |

| 深度学习 | 125 TeraFLOPS | 112 TeraFLOPS |

| 双向互联带宽 | 300 GB/s | 32 GB/s |

| GPU内存显存带宽 |

容量:32/16 GB HBM2 带宽:900 GB/s |

|

| 功率最大功耗 | 300W | 250W |

NVIDIA® Tesla® V100 Tensor Core 是有史以来极其先进的数据中心 GPU,能加快 AI、

高性能计算 (HPC) 和图形技术的发展。其采用 NVIDIA Volta 架构,并带有 16 GB 和 32GB 两种配置,

在单个 GPU 中即可提供高达 100 个 CPU 的性能。

如今,数据科学家、研究人员和工程师可以减少优化内存使用率的时间,

从而将更多时间用于设计下一项 AI 突破性作品。